L’équipe de vision par ordinateur du CRIM est appelée à résoudre toutes sortes de problèmes d’analyse d’images ou de vidéos reliés à des domaines aussi variés que l’inspection industrielle, la dermatologie, l’imagerie microscopique, l’imagerie 3D, etc.

Récemment, elle a été amenée à s’intéresser au problème de la ré-identification automatisée d’animaux qui joue un rôle crucial pour la compréhension des écosystèmes. Ce domaine est de plus en plus étudié, entre autres à cause de l’utilisation croissante de pièges photographiques (camera traps) qui capturent des volumes importants d’images d’animaux sauvages au moment de leur passage devant des caméras. Ces volumes d’images sont trop élevés pour être traités manuellement par les chercheurs. Les plateformes de recherche comme wildme.org, un outil important favorisant entre autres la science citoyenne, ont aussi un grand besoin d’algorithmes d’analyse d’images pour permettre à leurs utilisateurs d’alimenter les bases de données sur l’évolution des populations de multiples espèces.

Contexte

La station de recherche des îles Mingan (SRIM) a contacté l’équipe du CRIM pour lui proposer d’utiliser ses images de baleines bleues dans le but d’automatiser le processus de photo-identification. La photo-identification de baleines est une activité exigeante qui demande du temps et de l’expertise de pointe:

La même baleine se retrouve sur l’une des trois photos suivantes, pouvez-vous dire laquelle et ainsi réussir le test de photo-identification? 😁

A)

B)

C)

La photo qui correspond à la baleine inconnue est la photo C, prise à trois ans d’intervalle par rapport à la première photo. On l’aura compris, l’idée est de vérifier que les patrons de taches entre les deux individus sont les mêmes [1]:

Naturellement, la mise au point d’une méthode automatique de photo-identification pourrait grandement assister les biologistes dans la recherche de correspondances de photos, par exemple en réduisant la liste de candidats possibles.

Au cours des 40 dernières années, le SRIM a accumulé des milliers d’images de ces cétacés avec leurs métadonnées. Toutes ces informations peuvent-elles être utilisées par des techniques d’intelligence artificielle, plus précisément des techniques de vision par ordinateur, pour appuyer les chercheurs dans leurs activités de photo-identification? Et quelles méthodes sont les plus prometteuses?

Photo-identification automatisée: démarche et solutions

La revue de littérature sur le sujet a donné peu de résultats: c’est un problème qui a été très peu abordé dans la littérature scientifique. On pourrait penser qu’un algorithme développé pour photo-identifier une autre espèce de baleine pourrait servir de point de départ; or le processus de photo-identification peut être très différent d’une espèce à l’autre, parfois c’est la queue qui est distinctive, parfois c’est la tête ou la nageoire dorsale, etc.

Ce sont les taches sur la peau de la baleine bleue qui permettent de l’identifier et la meilleure piste algorithmique est du côté d’une famille de techniques qui permettent l’extraction et la comparaison de caractéristiques locales de l’image.

Les caractéristiques locales sont des signatures rattachées à des points précis dans une image (ex. appartenant à un objet) et qui ont des propriétés d’invariance, c’est-à-dire qu’elles ont à peu près la même valeur même si l’apparence de l’objet dans l’image change de façon marquée (point de vue différent, illumination différente, etc.).

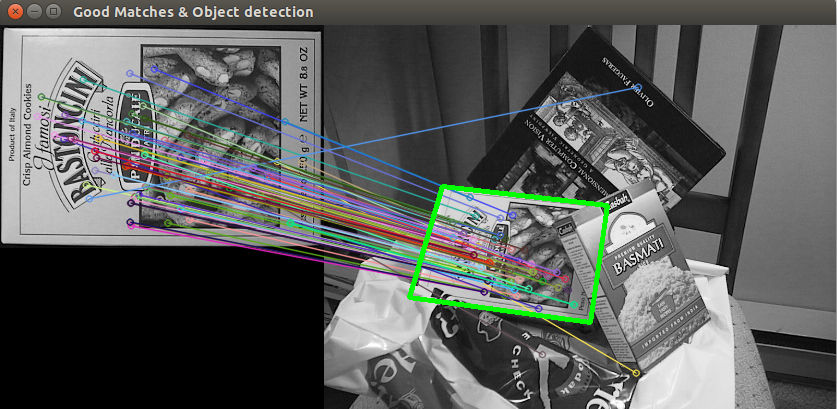

La figure suivante illustre l’idée, où des points visuellement similaires (localement) ont pu être reliés par des lignes parce que leurs signatures sont semblables, même si l’objet a une apparence différente (rotation, inclinaison, taille plus petite):

Dans ce contexte, à l’instar de la boîte de biscuits ci-dessus, deux images d’une même baleine auront plusieurs points de correspondance et plus les correspondances seront nombreuses, plus les chances seront élevées que les images proviennent du même individu.

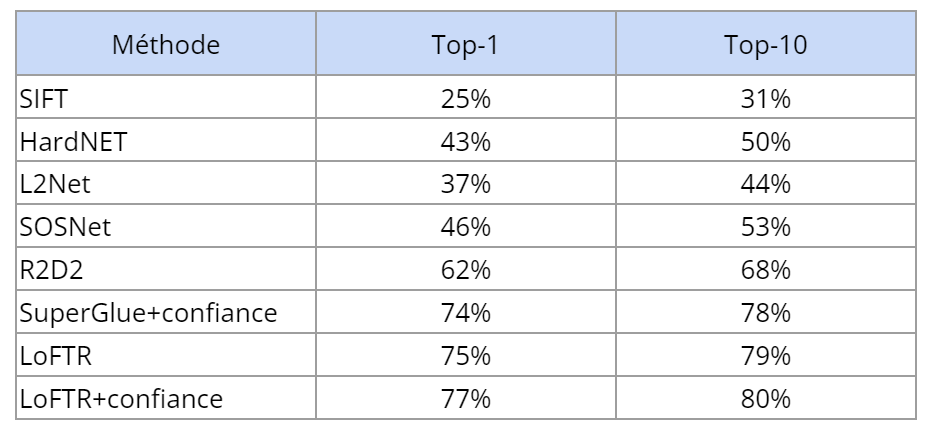

Nous avons évalué plusieurs algorithmes d’extraction et de comparaison de caractéristiques locales sur un jeu de données de bonne taille (807 individus différents, 3129 images au total). On peut les classer en trois catégories:

- Classiques: la construction des signatures est développée (hand-crafted) par des chercheurs en vision et celles-ci sont comparées par distance euclidienne, comme par exemple SIFT;

- Basés sur des réseaux de neurones (RN) pour la génération des signatures des points de correspondances;

- Architectures de RN de type bout-en-bout (end-to-end) qui acceptent une paire d’images en entrée et qui produisent la liste de correspondances en sortie.

Les résultats sont donnés dans le tableau suivant. Si pour une image analysée on considère les dix candidats-baleines les plus probables donnés par l’algorithme, le critère top-10 est la proportion d’individus qui se retrouvent dans cette liste. Le critère top-1 indique la proportion d’individus qui sont au premier rang dans la liste.

Deux points sont à souligner:

- La variabilité dans la performance des méthodes testées est grande, ce qui indique probablement que le problème est difficile à résoudre;

- Les meilleurs résultats sont donnés par les méthodes qui proposent une approche bout-en-bout (LoFTR, Superglue). Les autres approches brisent le problème en trois étapes (recherche de points d’intérêt dans chaque image, calcul de signature par réseaux de neurones, recherche de signatures semblables entre deux images).

Notons que les méthodes bout-en-bout fournissent également un degré de confiance pour chaque correspondance, qui donne de l’information sur la qualité de la correspondance: l’utilisation de cette information permet d’obtenir une performance légèrement meilleure que la simple utilisation du compte de correspondances.

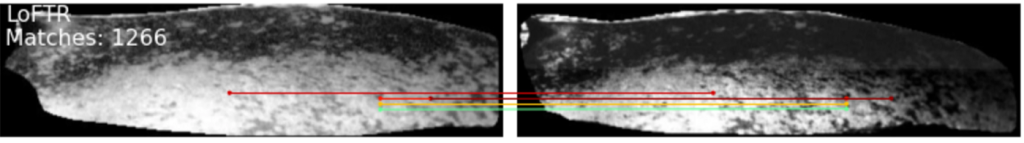

Cette dernière méthode, LoFTR [2], donne des résultats impressionnants quant à sa capacité à trouver des correspondances. Un examen attentif (ci-dessous) indique clairement que les points reliés par les lignes colorées correspondent à des zones similaires, donc la paire d’images provient de la même baleine:

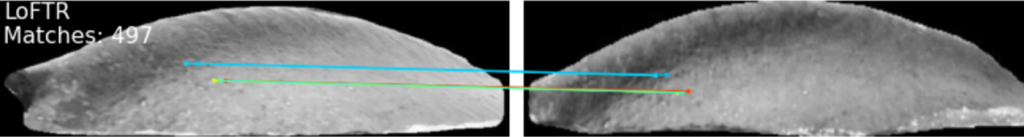

Un autre exemple:

Pour plus de détails, les lecteurs intéressés peuvent aussi consulter une publication [3] présentée à la conférence “Computer Vision for Analysis of Underwater Imagery (CVAUI) 2022” en août dernier. La classe de maîtres tenue le 23 septembre dernier et disponible ci-dessous, explique plus en détail la démarche suivie pour trouver une solution à ce problème.

Conclusion

Grâce à la riche base de données de SRIM, les experts du CRIM ont pu développer des algorithmes de “matching” d’images de baleines bleues qui sont prometteurs malgré la difficulté de la tâche. Mais au-delà de la photo-identification des baleines, de nombreux problèmes de comparaison d’images et de détection d’objets dans des images peuvent bénéficier des puissants outils de vision par ordinateur mentionnés dans ce billet.

Références

[1] R. Sears et al. “Photographic identification of the blue whale (Balaenoptera musculus) in the Gulf of St. Lawrence, Canada.”

[2] J. Sun et al. “LoFTR: Detector-Free Local Feature Matching with Transformers”.

[3] M. Lalonde et al. “Automated blue whale photo-identification using local feature matching”.